Сейчас внимательно посмотрю и разберусь…

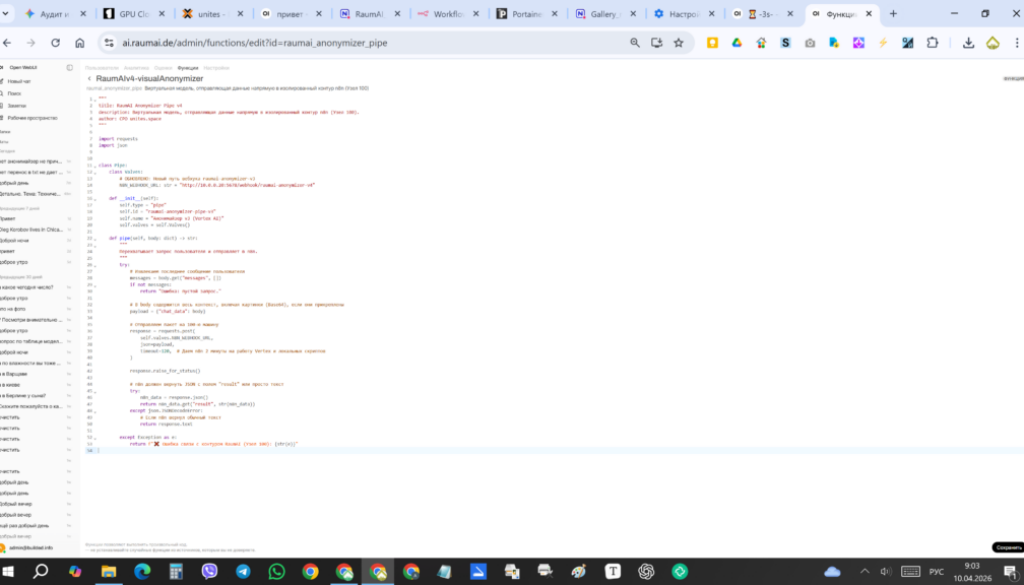

Эта функция — **RaumAlv4-visualAnonymizer** — является «братом» предыдущей, но она еще более «тяжелая» и опасная для стабильности интерфейса.

### Что я вижу в коде:

1. **Это Pipe (Пайп):** В отличие от фильтров, которые работают «фоном», эта функция создает в списке моделей отдельную модель под названием **«Анонимайзер v3 (Vertex AI)»**. Если у вас в чате выбрана именно эта модель, то каждое сообщение проходит через этот код.

2. **Передача ВСЕХ данных (`payload = {«chat_data»: body}`):** Это критический момент. В строке 33 код берет **весь** объект `body` (который включает всю историю чата, все системные промпты и, что самое важное, **все вложенные картинки в формате Base64**) и пытается отправить это на ваш сервер n8n.

* *Почему это вешает чат:* Если вы вставили большой JSON или в чате есть тяжелые изображения, объем данных становится огромным. Браузеру нужно упаковать это в один запрос и отправить по сети.

3. **Огромный таймаут (`timeout=120`):** Здесь таймаут увеличен до **2 минут** (120 секунд). Если сервер n8n не отвечает мгновенно, интерфейс Open WebUI будет «мертво» висеть 2 минуты, ожидая ответа от этого скрипта.

4. **Синхронный запрос:** Опять используется `requests.post`, который блокирует работу всей вкладки до получения ответа.

—

### Почему зависает, даже если вы «отключили» функции?

Тут есть важный нюанс Open WebUI:

Если эта функция включена в разделе **Workspace -> Functions**, она появляется в списке моделей. Если вы начали чат с этой моделью («Анонимайзер v3»), то даже если вы выключите другие фильтры, этот «Пайп» продолжит работать, так как он является «мозгом» текущего чата.

**Как проверить:**

1. Посмотрите наверх, в название чата. Какая модель там выбрана? Если там написано **«Анонимайзер v3…»**, переключите её на обычную модель (например, GPT-4, Claude или вашу локальную через Ollama).

2. Попробуйте вставить ваш JSON в чат, где выбрана **стандартная модель**.

### Мой вердикт по этой функции:

Этот код — «узкое горлышко». Он пытается пропихнуть через себя слишком много данных (весь контекст чата) и делает это синхронно. При вставке больших JSON-данных он просто захлебывается.

**Что делать с этим кодом:**

Его нужно оптимизировать, чтобы он отправлял в n8n не весь `body`, а только последнее сообщение пользователя (`body[«messages»][-1][«content»]`). Это сократит объем передаваемых данных в десятки раз.

**У вас остались еще функции в списке?** Мы почти закончили аудит. Если есть еще — присылайте! Если нет, я напишу, как исправить те, что мы уже нашли.

🤖 | 📅 | 🧠 CTX 6