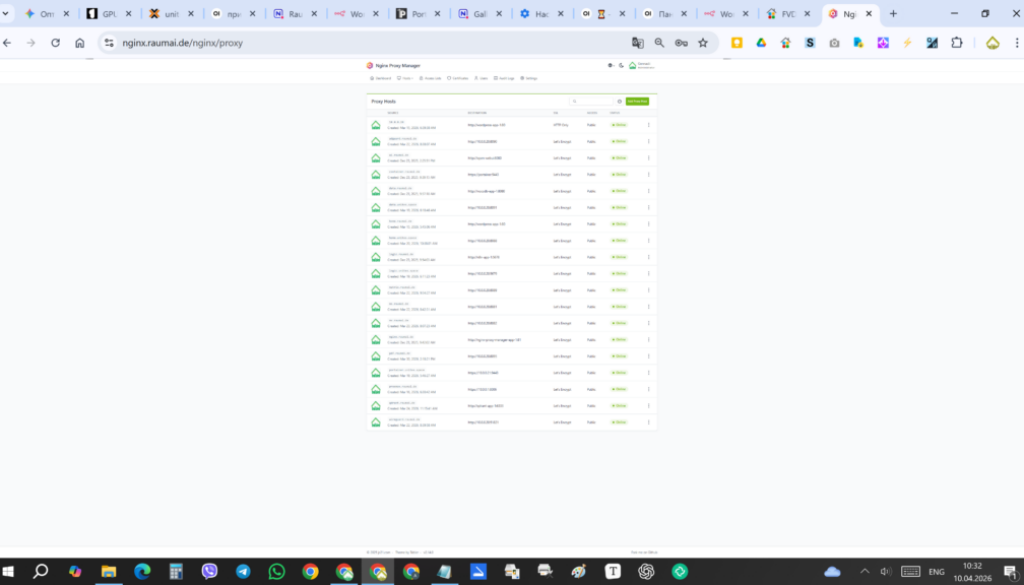

Сейчас внимательно посмотрю и разберусь.

На скриншоте я вижу панель управления **Nginx Proxy Manager (NPM)**. Это именно то место, где настраиваются правила прохождения трафика для ваших поддоменов (`ai.raumai.de`, `logic.raumai.de` и других).

Если большой JSON «отваливается» или не доходит, вам нужно внести изменения в настройки конкретного прокси-хоста. Скорее всего, это либо **ai.raumai.de** (интерфейс чата), либо **logic.raumai.de** (ваш n8n).

### Инструкция по настройке в Nginx Proxy Manager:

1. **Выберите нужный хост:** В списке Proxy Hosts найдите тот, через который вы работаете (например, `ai.raumai.de`).

2. **Откройте редактирование:** Нажмите на три точки в правой части строки этого хоста и выберите **Edit**.

3. **Перейдите во вкладку Advanced:** Это четвертая вкладка в открывшемся окне.

4. **Вставьте конфигурацию:** В поле «Custom Nginx Configuration» добавьте следующие строки, чтобы снять ограничения на размер данных и время ожидания:

«`nginx

client_max_body_size 50M;

proxy_connect_timeout 600;

proxy_send_timeout 600;

proxy_read_timeout 600;

send_timeout 600;

«`

### Почему это важно:

* **client_max_body_size:** По умолчанию Nginx часто ограничивает загрузку 1–2 МБ. Большой JSON легко превышает этот лимит, и сервер просто обрывает соединение (ошибка 413).

* **proxy_read_timeout:** Если ваш поток (flow) в n8n обрабатывает данные дольше нескольких секунд, прокси может закрыть соединение, не дождавшись ответа.

**Совет:** Я рекомендую проделать это и для `ai.raumai.de`, и для `logic.raumai.de`, так как данные проходят через оба узла в вашей Pro-сборке.

После сохранения настроек в NPM (кнопка **Save**) изменения вступят в силу мгновенно. Попробуйте снова отправить JSON. Если ошибка повторится — значит, нужно будет смотреть логи уже внутри Docker-контейнера n8n.

🤖 | 📅 | 🧠 CTX 6