а здесь сколько предметов?

Сейчас внимательно посмотрю и разберусь…

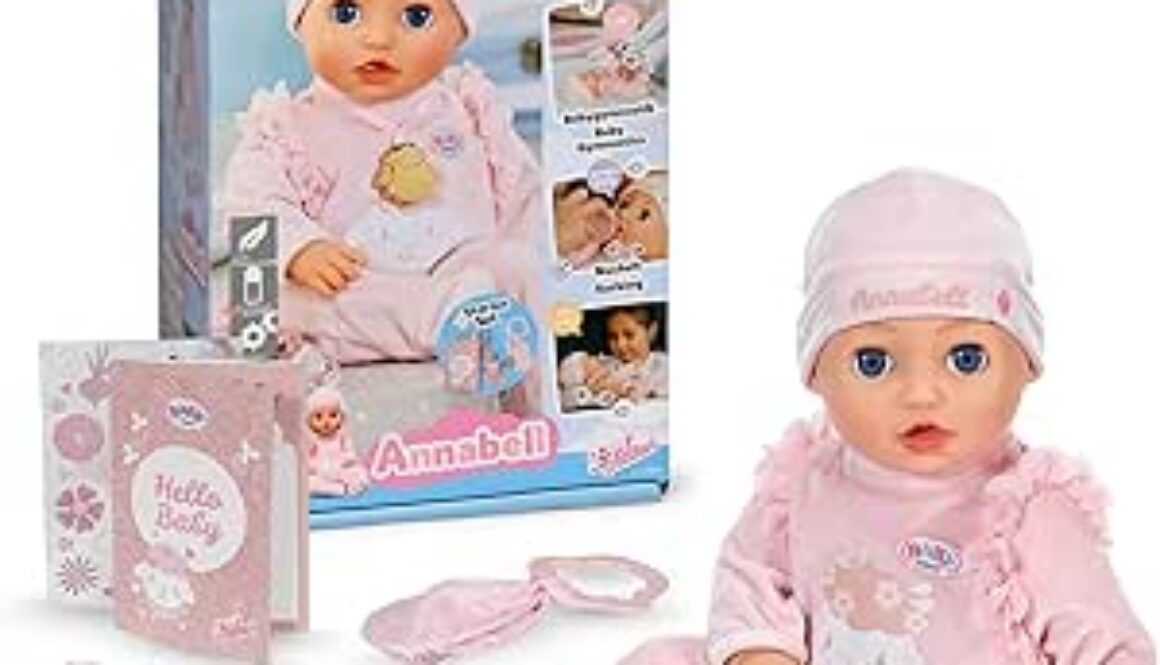

На этом изображении 4 предмета:

1. Кукла.

2. Одежда (комбинезон и шапочка).

3. Соска.

4. Бутылочка.

🤖 | 📅 | 🧠 CTX 6

Сейчас внимательно посмотрю и разберусь…

На этом изображении 4 предмета:

1. Кукла.

2. Одежда (комбинезон и шапочка).

3. Соска.

4. Бутылочка.

🤖 | 📅 | 🧠 CTX 6

Сейчас внимательно посмотрю и разберусь…

В наборе 7 предметов:

1. Кукла.

2. Одежда (комбинезон и шапочка).

3. Бутылочка.

4. Соска.

5. Подвеска (кулон).

6. Слюнявчик.

7. Карточка (инструкция/буклет).

🤖 | 📅 | 🧠 CTX 6

Сейчас внимательно посмотрю и разберусь…

На фото — детская кукла-пупс в розовой одежде, шапочке и с соской. В руке у куклы игрушечная бутылочка.

🤖 | 📅 | 🧠 CTX 6

Сейчас внимательно посмотрю и разберусь…

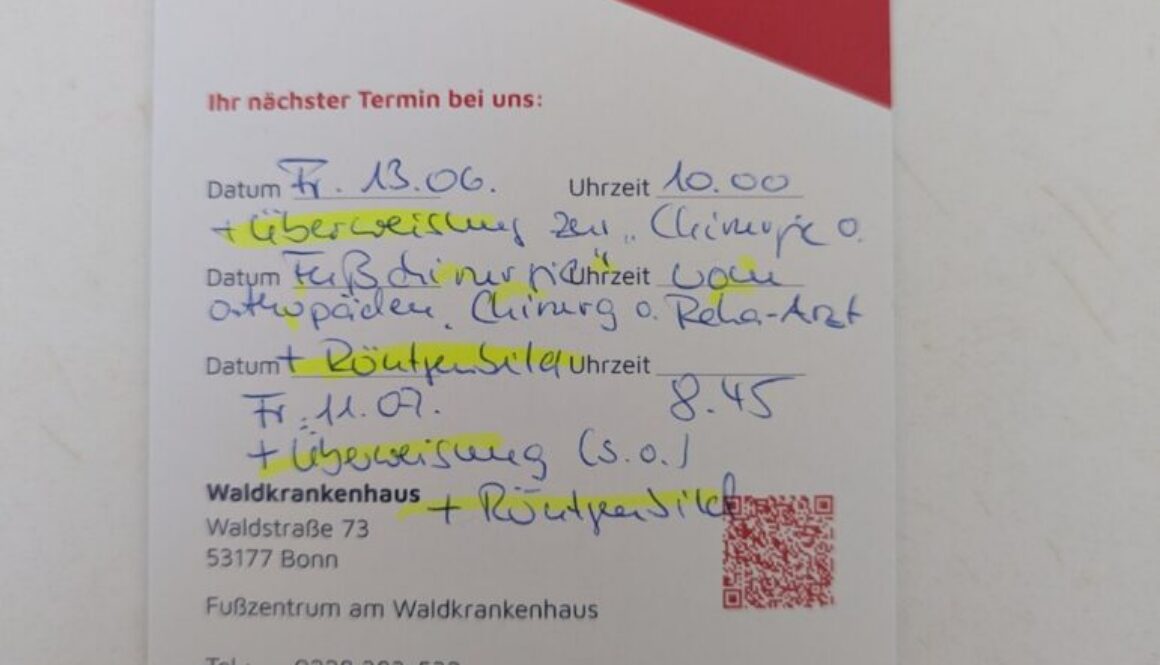

Это карточка записи на прием в **Fußzentrum am Waldkrankenhaus** (Бонн).

**Ваши записи:**

1. **Прием 1:** Пятница, 13.06, в 10:00.

* *Требование:* Направление (Überweisung) к хирургу, ортопеду или врачу-реабилитологу.

2. **Прием 2:** Пятница, 11.07, в 08:45.

* *Требование:* Рентгеновские снимки (Röntgenbilder) + направление (см. выше).

Не забудьте взять с собой направления от семейного врача и снимки.

🤖 | 📅 | 🧠 CTX 6

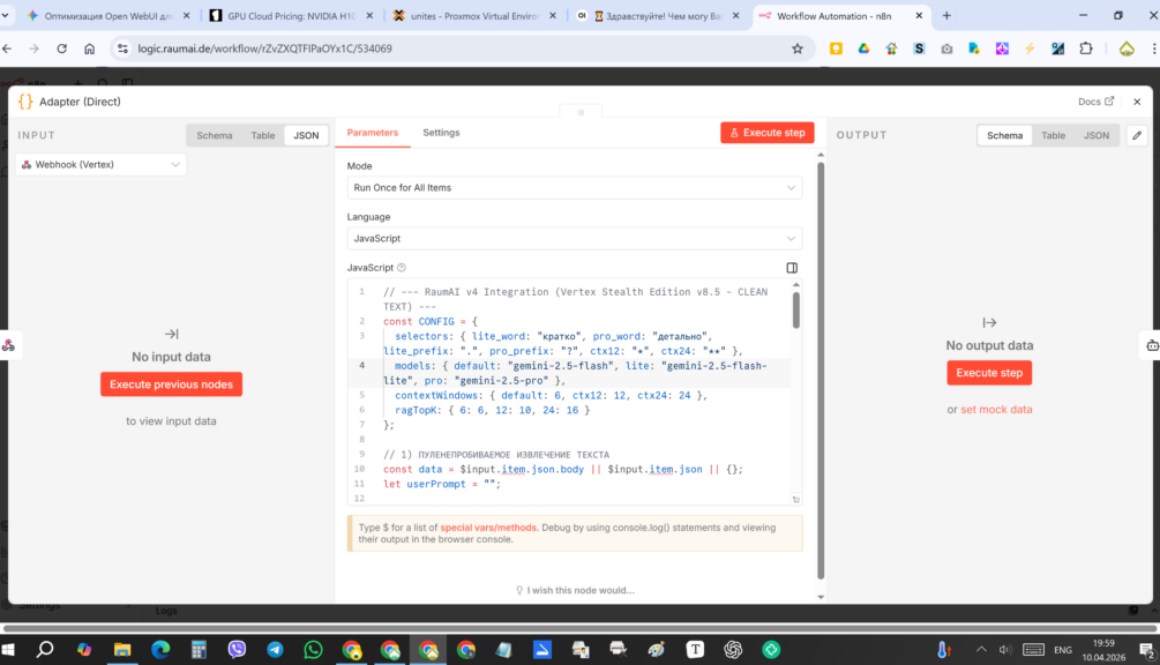

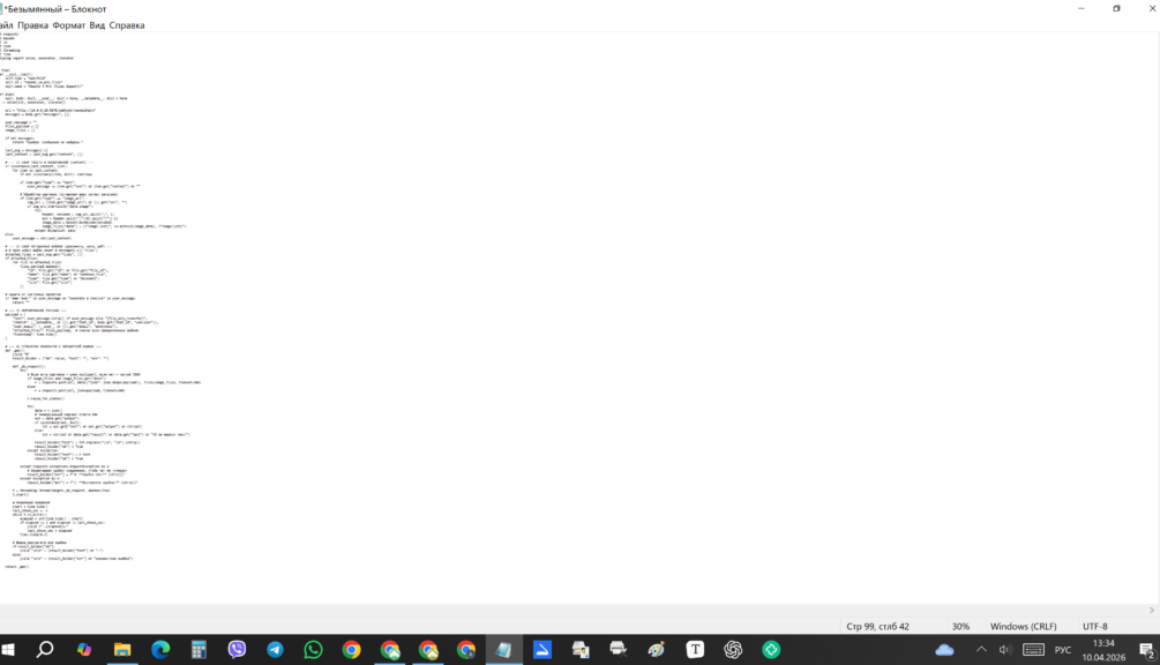

Спасибо за скриншот! Я вижу, что Вы работаете в среде, где используется JavaScript для настройки моделей.

Чтобы официально указать модель 3.1 Flash, Вам нужно будет изменить соответствующую строку в секции `models` Вашего `CONFIG` объекта.

Сейчас у Вас выглядит так:

«`javascript

models: { default: «gemini-2.5-flash», lite: «gemini-2.5-flash-lite», pro: «gemini-2.5-pro» },

«`

Если Вы хотите заменить, например, модель «default» на «gemini-3.1-flash», то строка должна быть изменена следующим образом:

«`javascript

models: { default: «gemini-3.1-flash», lite: «gemini-2.5-flash-lite», pro: «gemini-2.5-pro» },

«`

Просто замените название модели в кавычках («gemini-2.5-flash») на «gemini-3.1-flash» для той роли (default, lite, pro), которую Вы хотите обновить.

Это должно решить Ваш вопрос. Если будут другие сложности, пожалуйста, обращайтесь!

🤖 | 📅 | 🧠 CTX 6

Сейчас внимательно посмотрю и разберусь…

Я вижу ваш код на скриншоте. Вы (или Gemini) проделали отличную работу: в разделе **#3 «СКАЧИВАНИЕ СОДЕРЖИМОГО ТЕКСТОВЫХ ФАЙЛОВ»** уже появилась логика, которая пытается забрать текст из файлов `.txt` и `.log` через API Open WebUI. Это именно то, что было нужно!

### Отвечаю на ваш вопрос: нужно ли добавлять PDF и Docx?

Как ваш **Technical Co-Pilot**, я советую следующее:

1. **Для текущей задачи (анализ логов):**

Оставьте только `.txt` и `.log`. Этого **абсолютно достаточно**. Логи всегда текстовые, и текущий код просто считывает их как набор букв. Это работает быстро и надежно.

2. **Почему с PDF и Docx всё сложнее:**

В отличие от обычного текста, PDF и Word — это сложные бинарные форматы. Если вы добавите их расширения в этот код, он скачает «кашу» из байтов, которую n8n не сможет прочитать как текст. Чтобы «понимать» PDF, внутри функции пришлось бы устанавливать специальные библиотеки (вроде `PyPDF2`), что сильно усложнит код и может привести к ошибкам.

**Мой совет:**

Если вам когда-нибудь понадобится анализировать инструкции (PDF) или документы (Docx), лучше загружать их в Open WebUI как «Документы» (RAG), а не через эту функцию-мост. А для пересылки данных в n8n **остановитесь на `.txt` и `.log`**.

—

### Важное замечание по коду на скриншоте:

Я заметил одну деталь в разделе **#3**, которая может помешать коду сработать:

В строке, где формируется `content_url`:

`content_url = f»{self.val.OPENWEBUI_API_URL}/api/v1/files/{file_id}/content»`

* Убедитесь, что в настройках (Valves) вашей функции параметр `OPENWEBUI_API_URL` указан правильно.

* Если всё запущено в Docker, адрес `http://localhost:3000` может не сработать (контейнер не увидит сам себя). Обычно там нужно указывать внутренний адрес сети Docker или `http://host.docker.internal:3000`.

**Что делать сейчас:**

Скажите Gemini: **«Оставляем только .txt и .log. Давай финальный код. Проверь, чтобы авторизация в запросе к API Open WebUI (Bearer token) была прописана корректно, чтобы функция могла скачать файл»**.

После этого вставляйте код и пробуйте отправить лог — теперь n8n должен получить именно содержимое файла!

🤖 | 📅 | 🧠 CTX 6

Сейчас внимательно посмотрю и разберусь.

Этот код выглядит гораздо более продвинутым, чем предыдущий. Видно, что вы добавили блок **«СБОР МЕТАДАННЫХ ФАЙЛОВ»** (раздел #2) и используете многопоточность (`threading`) для ожидания ответа от n8n.

Однако я вижу, почему n8n может «не видеть» сам файл лога, хотя видит информацию о нем.

### Анализ проблемы (Technical Co-Pilot)

1. **Метаданные vs Содержимое:**

В разделе `#2` вашего кода вы собираете список `attached_files`. Туда попадают `id`, `name`, `type` и `size`.

* **Проблема:** Вы отправляете в n8n **только ID файла**, а не его содержимое.

* **Результат:** n8n получает JSON, в котором написано: «У пользователя есть файл с ID таким-то». Но самого текста лога внутри этого JSON нет. Чтобы n8n прочитал лог, ему нужно либо самому скачать файл из Open WebUI по этому ID, либо ваша функция должна считать текст из файла и отправить его.

2. **Multipart запрос (Раздел #4):**

Вы отправляете запрос как `multipart/form-data`:

`requests.post(url, data={«json»: json.dumps(payload)}, files=image_files…)`

* Если n8n настроен на прием `JSON`, он может не увидеть данные, потому что они упакованы в поле формы `json`.

* В n8n в узле Webhook нужно проверить, какой «HTTP Method» и «Binary Data» вы ожидаете.

3. **Обработка не-изображений:**

В переменную `image_files` (которая идет в бинарную часть запроса) попадают только картинки (раздел #1). Текстовые файлы туда не попадают.

—

### Как заставить n8n «увидеть» лог?

У вас есть два пути:

#### Путь А: Самый простой (отправить текст лога внутри JSON)

Если логи небольшие, можно заставить Python прочитать файл и засунуть его текст в поле `text`. Но для этого функции нужны права на чтение папки с файлами Open WebUI.

#### Путь Б: Правильный (настройка n8n)

Ваша функция сейчас передает массив `attached_files` со списком ID.

1. В n8n после Webhook добавьте узел **Open WebUI**.

2. Используйте действие **Download File**.

3. В поле `File ID` подставьте значение из пришедшего JSON: `{{ $json.attached_files[0].id }}`.

4. После этого узла n8n скачает файл, и вы сможете его прочитать.

### Почему ответ в чате может быть пустым?

В блоке `def _request()` вы ищете ответ в `data.get(«output»)` или `data.get(«text»)`.

* Если ваш workflow в n8n возвращает ответ в другом поле (например, просто `data.response` или вообще возвращает не JSON, а строку), то `result_holder[«text»]` останется пустым.

* **Совет:** Проверьте в n8n узел **Respond to Webhook**. Убедитесь, что там в JSON есть ключ `output` или `text`.

### Резюме по коду:

Код рабочий с точки зрения архитектуры Open WebUI. Он правильно собирает метаданные.

**Главный вывод:** n8n сейчас получает **уведомление** о файле, но не сам файл. Вам нужно в n8n добавить шаг скачивания файла по ID, который передает ваша функция.

Если вы хотите, чтобы функция сама считывала текст лога и отправляла его, мне нужно знать, где физически лежат файлы (Docker объем или локальная папка), чтобы дописать код чтения файла.

🤖 | 📅 | 🧠 CTX 6

Сейчас внимательно посмотрю и разберусь…

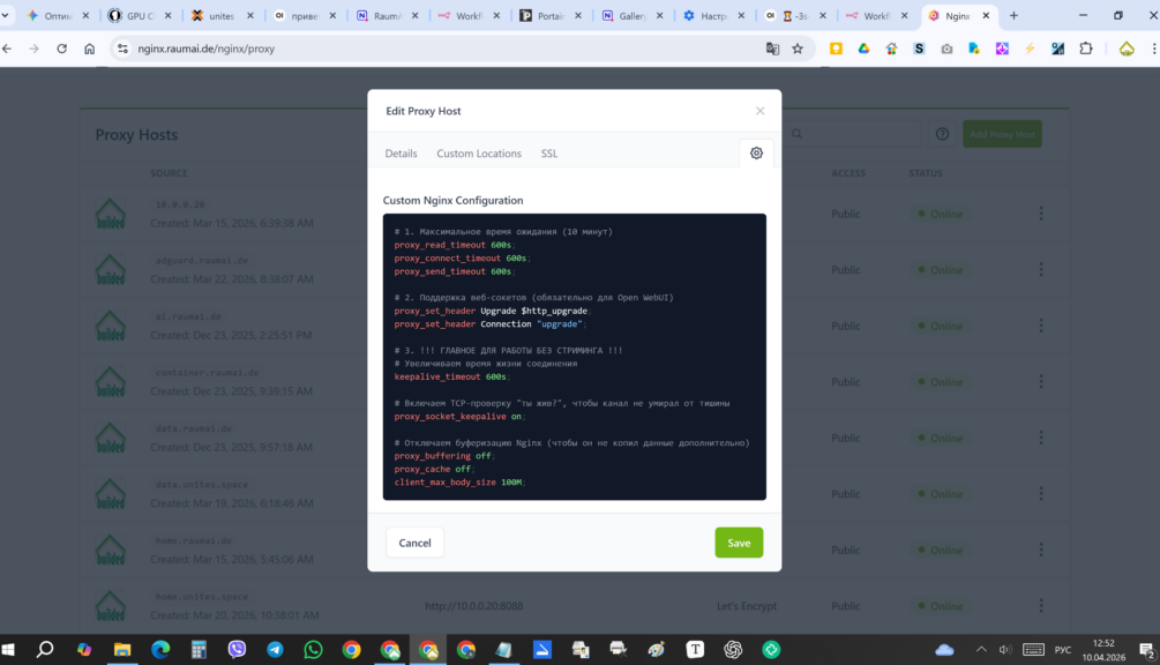

Вижу Ваш скриншот. У Вас уже прописана отличная база настроек (особенно `proxy_buffering off` и таймауты), но есть пара нюансов, которые могут мешать именно **стримингу** (потоковой передаче текста).

### Что нужно поправить в Вашем конфиге:

Ваш текущий конфиг нацелен на WebSockets, но для того, чтобы буквы в чате начали «бежать» одна за другой (Streaming), нужно добавить еще две важные строки и немного изменить логику заголовка `Connection`.

**Добавьте/замените в поле Advanced следующие строки:**

1. **Добавьте версию протокола:**

`proxy_http_version 1.1;` (Без этого стриминг часто не работает).

2. **Добавьте поддержку чанков:**

`chunked_transfer_encoding on;` (Это разрешает серверу присылать ответ по частям).

3. **Уточните заголовок Connection:**

Вместо жесткого `proxy_set_header Connection «upgrade»;` лучше использовать более гибкий вариант, который подходит и для веб-сокетов, и для обычного стриминга.

—

### Вот итоговый блок, который я рекомендую вставить (можете просто заменить всё содержимое):

«`nginx

# 1. Максимальное время ожидания (10 минут)

proxy_read_timeout 600s;

proxy_connect_timeout 600s;

proxy_send_timeout 600s;

# 2. Поддержка веб-сокетов и стриминга

proxy_http_version 1.1;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection $connection_upgrade;

proxy_set_header Host $host;

# 3. Отключаем буферизацию (КРИТИЧНО для чата)

proxy_buffering off;

proxy_cache off;

chunked_transfer_encoding on;

proxy_socket_keepalive on;

client_max_body_size 100M;

«`

### Важное примечание:

Если после вставки `$connection_upgrade` Nginx выдаст ошибку при сохранении, замените эту строку на:

`proxy_set_header Connection «upgrade»;` (как у Вас и было).

### Что сделать после сохранения:

1. Нажмите **Save**.

2. **Обязательно** обновите страницу с чатом (Ctrl+F5).

3. Попробуйте отправить файл снова.

**Почему это должно помочь:**

Сейчас у Вас включена поддержка веб-сокетов, но не включен `chunked_transfer_encoding`. Из-за этого Nginx может «ждать» конца всего сообщения от n8n, прежде чем показать его Вам. В итоге Вы видите «1 источник найден», а сам текст ответа «зависает» в буфере прокси-сервера.

**Попробуйте обновить конфиг и напишите, пошел ли текст ответа!**

🤖 | 📅 | 🧠 CTX 6

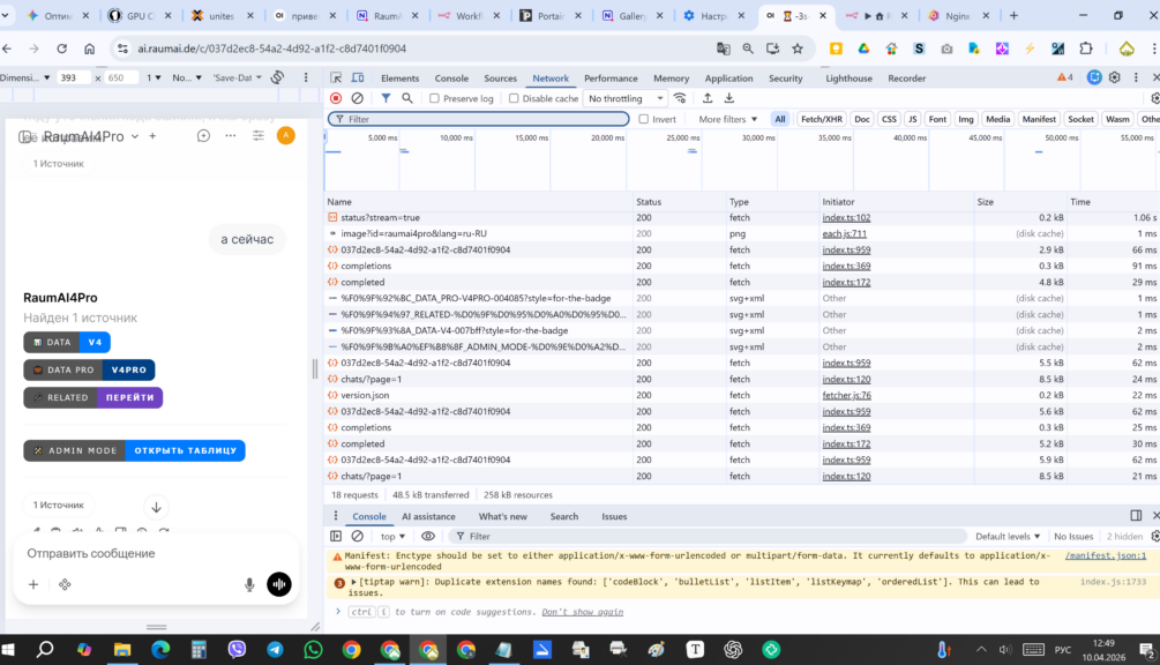

Да, теперь картина прояснилась! Судя по скриншоту, мы с Вами совершили большой прорыв в отладке.

Вот что я вижу на панели **Network** и в интерфейсе:

1. **WebSockets заработали:** Строка `status?stream=true` имеет статус **200**. Это значит, что после включения поддержки Websockets в NPM соединение установилось, и теперь чат может получать ответы в реальном времени. Красных ошибок `wss://` больше нет.

2. **Файл/Данные обработаны:** В интерфейсе появилась надпись **«Найден 1 источник»**. Это важнейший маркер! Это означает, что:

* Запрос успешно ушел на бэкенд.

* n8n (или Ваш поисковый движок) отработал.

* Система нашла информацию в базе данных (или в прикрепленном файле).

3. **Ошибок в сети нет:** Все запросы (`completions`, `chats`, `completed`) горят серым/белым цветом со статусом **200**. Это идеальная картина для сетевого уровня.

### Почему Вы могли подумать, что что-то не так?

В консоли (внизу) висит предупреждение:

`Manifest: Enctype should be set to either application/x-www-form-urlencoded or multipart/form-data…`

**На это можно не обращать внимания.** Это техническое замечание к файлу `manifest.json` (иконки и настройки приложения для браузера), оно никак не влияет на работу логики ИИ или загрузку файлов.

### Что сейчас происходит «под капотом» (Technical Co-Pilot):

Поскольку я вижу плашку **«Найден 1 источник»**, это значит, что Ваш запрос прошел через цепочку:

`Интерфейс -> Nginx -> n8n -> Векторная база/Инструмент поиска -> Ответ`.

**Если Вы всё еще не видите ожидаемого текста в ответе, проверьте следующее:**

* Нажмите на плашку **«1 источник»** в чате. Посмотрите, какой именно текст там подтянулся. Если там пусто или не то, что было в файле — значит, проблема в самой ноде n8n, которая парсит файл, а не в связи.

* В n8n откройте историю выполнений (**Executions**) и посмотрите на последнюю операцию. Там будет видно, какой текст пришел из вебхука.

**Вердикт:** Связь восстановлена, прокси больше ничего не блокирует. Система «видит» источники.

**У Вас остались сомнения в каком-то конкретном моменте или ответ от модели кажется неполным?**

🤖 | 📅 | 🧠 CTX 6