посмотрите пожалуйста

Сейчас внимательно посмотрю и разберусь…

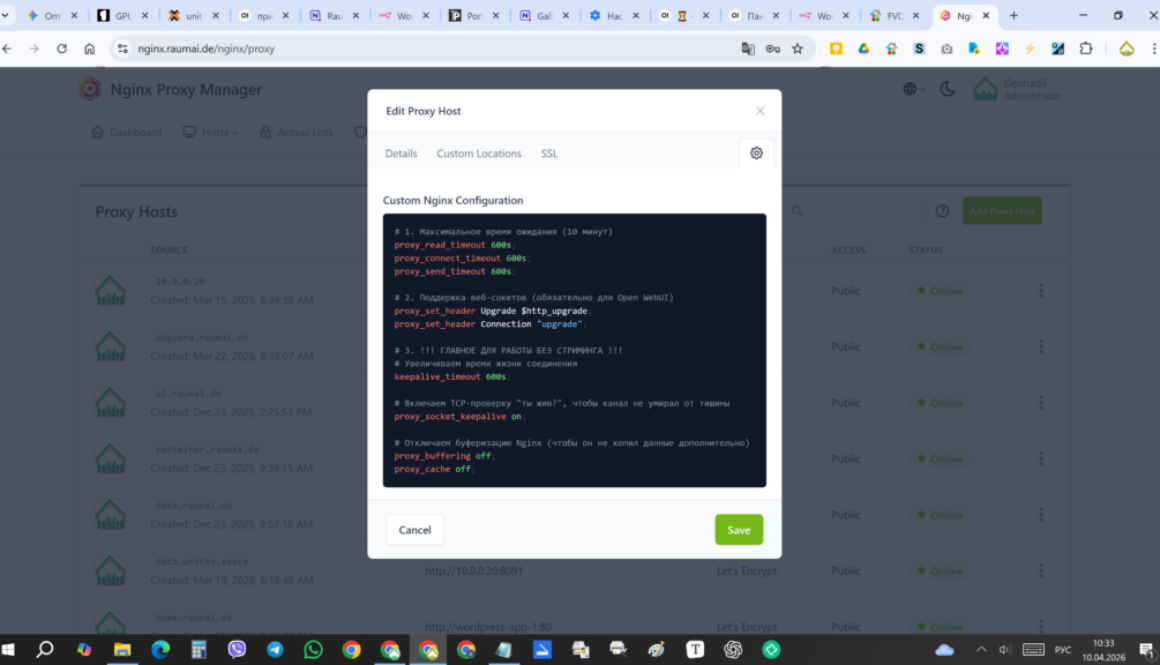

На скриншоте я вижу вкладку **Advanced** в настройках прокси-хоста в **Nginx Proxy Manager**. У Вас уже прописаны отличные базовые настройки для работы с ИИ-системами: увеличены таймауты до 10 минут (600s), включена поддержка веб-сокетов и отключена буферизация (что критически важно для стриминга ответов от LLM).

Однако для решения проблемы с «непрохождением» больших JSON-файлов здесь **не хватает одной ключевой директивы**.

### Что нужно добавить:

В самый верх или в конец этого списка добавьте строку:

«`nginx

client_max_body_size 100M;

«`

### Почему это важно:

По умолчанию Nginx ограничивает размер передаваемого тела запроса (body) значением **1 МБ**. Если Ваш JSON со всеми данными весит больше (а в Pro-сборках при передаче контекста это случается постоянно), Nginx просто обрывает соединение, выдавая ошибку `413 Request Entity Too Large`, и данные не доходят до n8n или модели. Установка `100M` (или больше, если нужно) снимет это ограничение.

### Итоговый список рекомендаций:

1. **Добавьте `client_max_body_size 100M;`** в это окно и нажмите **Save**.

2. **Проверьте тот же параметр для `logic.raumai.de`**: Если JSON идет в n8n, то в настройках прокси для n8n должна стоять такая же директива.

3. **Проверьте Cloudflare (если используете)**: Если Ваш домен `raumai.de` проксируется через Cloudflare (оранжевое облако), помните, что на бесплатном тарифе Cloudflare жестко ограничивает размер запроса до **100 МБ**. Если JSON больше — он не пройдет, даже если в Nginx всё настроено верно.

**Ваш текущий конфиг на скриншоте очень грамотный**, добавление лимита на размер тела запроса должно устранить проблему с «пустыми» сообщениями при отправке кода. Попробуйте применить и отправить JSON снова.

🤖 | 📅 | 🧠 CTX 6